All Watched Over by Machines of Loving Grace est un poème de 1967 écrit par Richard Brautigan qui décrit une cohabitation paisible et harmonieuse entre humains et machines. Cinquante ans plus tard - à la suite des révolutions technologiques apportées par internet, la big data, le cloud et le deep learning - la vision de Brautigan résonne singulièrement. Elle nous oblige à repenser nos interactions avec les machines, même en ce qui concerne l'acte intime de la création artistique. En collaboration avec ses partenaires américains, l'Institut de Recherche et Coordination en Acoustique/Musique (Ircam) invite les participants à découvrir quelques exemples remarquables de relations artistiques possibles entre l'homme et la machine au cours de deux séminaires réunissant des chercheurs et des artistes qui construisent cette nouvelle donne.

L'événement est co-organisé par l'IRCAM – Institut de Recherche et Coordination Acoustique/Musique – et laboratoire STMS (Ircam, Centre National de la Recherche Scientifique, le Ministère de la Culture et Sorbonne Université), en collaboration avec Georgia Tech’s School of Music, NYU Steinhardt – Music Education, UC Berkeley Center for New Music and Audio Technologies, et le Atlanta Office of the Cultural Services of the Embassy of France in the United States.

Dans le cadre du Festival France Atlanta 2020.

ÉVÉNEMENTS :

Webinairs

- "Working Creatively with Machines", 14 Octobre, 11h00 (Atlanta) / 17h00 (Paris) : Discussion ouverte sur la composition et l'écriture.

Introduction par Yves Berthelot, vice-président pour les Initiatives Internationales au Georgia Institute of Technology et Frank Madlener, président de l'Ircam.

Participants : Camine Emanuele Cella (CNMAT - CU Berkeley), Rémi Mignot (Ircam), Nicolas Obin (Sorbonne Université - Ircam), Alex Ruthman (NYU), Jason Freeman (Georgia Tech).

Gratuit / Revoir le streaming

- "Performances with Machines", 15 Octobre, 11h00 (Atlanta) / 17h00 (Paris) : Discussion ouverte sur la performance.

Participants : Jérôme Nika (Ircam), Benjamin Levy (Ircam), Grace Leslie (Georgia Tech), Daniele Ghisi (compositeur), Elaine Chew (CNRS).

Gratuit / Revoir le streaming

Exposition virtuelle

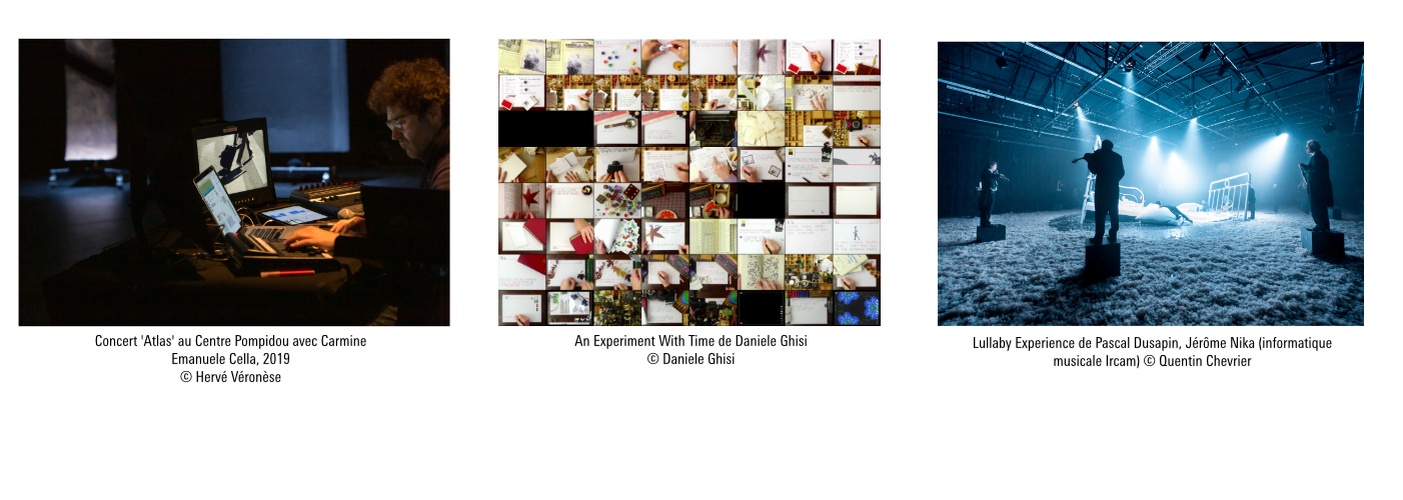

Du 12 octobre au 10 novembre, une exposition virtuelle est accessible afin de présenter des extraits d'œuvres et d'outils qui s'appuient fortement sur les techniques de l'intelligence artificielle et qui questionnent la relation homme-machine. L'exposition comprend des œuvres d'artistes et de chercheurs tels que Daniele Ghisi (compositeur), Jérôme Nika et Gérard Assayag (chercheurs, Ircam), Jason Freeman (Georgia Tech), Carmine Emanuele Cella (professeur et compositeur, CNMAT - CU Berkeley), Alex Ruthman (professeur, New York University).

Panelists biography

- Daniele Ghisi : Né en Italie en 1984, Daniele Ghisi a étudié la composition musicale au Conservatoire de Bergame avec S. Gervasoni et a poursuivi ses études avec le Cursus de l'IRCAM. En 2009-2010, il est compositeur en résidence à l'Akademie der Künste (Berlin), en 2011-2012, il est compositeur en résidence en Espagne, membre de l'Académie de France à Madrid - Casa de Velázquez. En 2015, il est en résidence à Milan, avec l'ensemble Divertimento, qui a enregistré son premier CD monographique (Geografie). Depuis 2010, il développe, avec le compositeur Andrea Agostini, "bach : aide automatique au compositeur", bibliothèque de composition assistée par ordinateur. Il est le co-fondateur du blog nothing.eu, dans lequel il écrit. Il est édité par Ricordi. Entre 2017 et 2020, il enseigne la composition électroacoustique au Conservatoire de Gênes. Il est actuellement chercheur-compositeur à l'Université de Californie, Berkeley (CNMAT).

- Elaine Chew : Elaine Chew est chercheuse principale du CNRS au laboratoire STMS de l'Ircam et professeure invitée au King's College London. Ses recherches portent sur la modélisation mathématique et informatique des structures musicales et dans les séquences électrocardiographiques. Les outils sont utilisés pour expliquer les performances de premier plan, comprendre les interactions entre musique, cœur et cerveau, stratifier les arythmies en sous-types et générer de la musique AI. Son travail a été reconnu par les prix PECASE et NSF CAREER, par des bourses du Radcliffe Institute for Advanced Study de Harvard, et par les prix ERC, ADG et POC. Elle a été professeure de médias numériques à la QMUL (2011-2019), professeur associé adjoint/titulaire et titulaire de la chaire Viterbi Early Career à l'USC (2001-2013). et a occupé des postes de professeure invitée à Harvard (2008-2009) et à Lehigh (2000-2001). En tant que pianiste, elle intègre ses recherches dans des concert-conversations qui mettent en valeur des visualisations scientifiques et des compositions créées en laboratoire. Elle est titulaire d'un doctorat et d'une maîtrise en recherche opérationnelle du MIT, d'un BAS en sciences mathématiques et informatiques (avec mention) et en musique (avec distinction) de Stanford, ainsi que de diplômes de piano LTCL/FTCL.

- Jérome Nika : Jérôme Nika est chercheur en interaction musicale homme-machine au sein de l'équipe Représentations musicales de l'Ircam. Il est diplômé des Grandes Écoles Télécom ParisTech et de l'ENSTA ParisTech. Il a également étudié l'acoustique, le traitement du signal et l'informatique appliqués à la musique, ainsi que la composition. Il s'est spécialisé dans les applications informatiques et du traitement du signal à la création numérique et à la musique à travers un doctorat (Prix du jeune chercheur en science et musique, 2015 ; Prix du jeune chercheur décerné par l'Association française de musique informatique, 2016), puis comme chercheur à l'Ircam. Ses recherches portent sur l'introduction de l'écriture, de la composition et du contrôle dans la co-improvisation de la musique par l'homme et la machine. Ces travaux ont donné lieu à de nombreuses collaborations et productions musicales, notamment dans le domaine des musiques improvisées (Steve Lehman, Bernard Lubat, Benoît Delbecq, Rémi Fox) et des musiques contemporaines (Pascal Dusapin, Marta Gentilucci). En 2019 - 2020, son travail a été impliqué dans 3 productions d'ambitions : Lullaby Experience, un projet évolutif du compositeur Pascal Dusapin, et deux projets de musique improvisée : Silver Lake Studies, en duo avec Steve, et C'est Pour ça, en duo avec Rémi Fox. En 2020, il est en résidence au Fresnoy - Studio National des Arts Contemporains. Plus d'infos : https://jeromenika.com

- Gérard Assayag : Gérard Assayag, directeur de recherche à l'Ircam, est à la tête de l'équipe Représentations musicales de l'Ircam, une équipe qu'il a fondée en 1992. Il a dirigé le laboratoire de recherche de l'Ircam (STMS, un laboratoire commun entre l'Ircam, le CNRS et Sorbonne Université) entre 2011 et 2017. Ses intérêts de recherche sont centrés sur les questions de représentation musicale, notamment les langages de programmation, l'apprentissage machine, la programmation par contraintes et la programmation visuelle, la musicologie computationnelle, la modélisation musicale, et enfin la composition et l'interaction assistées par ordinateur. Il a conçu avec ses collaborateurs OpenMusic et OMax, deux environnements logiciels de recherche musicale qui ont acquis une réputation internationale et sont utilisés dans de nombreux pays pour la composition, l'analyse et l'improvisation assistées par ordinateur.

- Jason Freeman : Jason Freeman est professeur de musique à Georgia Tech et président de l'école de musique. Sa pratique artistique et ses recherches universitaires se concentrent sur l'utilisation de la technologie pour engager divers publics dans des expériences musicales collaboratives, expérimentales et accessibles. Il développe également des interventions éducatives dans des environnements K-12, universitaires et MOOC qui élargissent et augmentent l'engagement dans les disciplines STEM grâce à des intégrations authentiques de la musique et de l'informatique. Sa musique a été jouée au Carnegie Hall, exposée à ACM SIGGRAPH, publiée par Universal Edition, diffusée sur la radio publique dans le cadre de Performance Today, et commandée grâce au soutien de la National Endowment for the Arts. L'œuvre de Freeman, d'une grande portée, a attiré plus de 10 millions de dollars de financement de sources telles que la National Science Foundation, Amazon et Turbulence. Il a été diffusé par le biais de plus de 80 chapitres de livres, d'articles de journaux et de publications de conférences. M. Freeman a obtenu une licence en musique à l'université de Yale et une maîtrise et un doctorat en composition à l'université de Columbia.

- Carmine Emanuele Cella : Carmine Emanuele Cella est un compositeur de renommée internationale ayant fait des études supérieures en mathématiques appliquées. Il a étudié au Conservatoire de musique G. Rossini en Italie où il a obtenu une maîtrise en piano, en informatique musicale et en composition. Il a également obtenu un doctorat en composition musicale à l'Accademia di S. Cecilia à Rome. Il a étudié la philosophie et les mathématiques et a obtenu un doctorat en logique mathématique à l'Université de Bologne intitulé "On Symbolic Representations of Music" (2011). En 2007-2008, Carmine-Emanuele Cella travaille comme chercheur à Paris dans l'équipe Analyse/Synthèse de l'Ircam sur l'indexation audio et depuis janvier 2019, il est professeur assistant de musique et de technologie à l'Université de Berkeley.

- Alex Ruthmann : S. Alex Ruthmann est professeur associé en éducation musicale et technologie musicale, et directeur du Music Experience Design Lab (MusEDLab) de l'université de New York à Steinhardt. Il est affilié au programme NYU Digital Media Design for Learning et au programme sur la créativité et l'innovation de NYU Shanghai. Il est actuellement président de la commission musicale dans les écoles et de la formation des enseignants de la Société internationale pour l'éducation musicale. Ruthmann est co-auteur de Scratch Music Projects, un nouveau livre publié par Oxford University Press qui présente aux étudiants et aux enseignants des projets de musique et de codage créatifs. Il est co-éditeur de l'Oxford Handbook of Technology and Music Education et du Routledge Companion to Music, Technology and Education. Il est également rédacteur en chef adjoint du Journal of Music, Technology, and Education. Les recherches de Ruthmann se concentrent sur la conception de nouvelles technologies et expériences pour la création, l'apprentissage et l'engagement musical. Parmi ses partenaires, on compte le New York Philharmonic, le Shanghai Symphony, Peter Gabriel, Herbie Hancock, Yungu and Portfolio Schools, Tinkamo, l'UNESCO et la Rock and Roll Forever Foundation. Les projets d'apprentissage créatif et de logiciels du MusEDLab sont activement utilisés par plus de 900 000 personnes dans plus de 150 pays à travers le monde.

- Rémi Mignot : Rémi Mignot est un chercheur de l'équipe Analyse/Synthèse de l’Ircam. En 2009, il a obtenu sa thèse de doctorat de l'école doctorale EDITE, sur la modélisation et la simulation des ondes acoustiques pour les instruments à vent, avec Thomas Hélie (Ircam) et Denis Matignon (Supaero). En 2010-2012, il a rejoint l'Institut Langevin (Paris) pour une recherche post-doctorale sur l'échantillonnage des réponses impulsionnelles d'une pièce à l'aide de la détection comprimée, avec Laurent Daudet (Paris Diderot) et François Ollivier (UPMC). En 2012-2014, il part pour le département de traitement du signal et d'acoustique de l'université Aalto à Espoo (Finlande), pour travailler avec Vesa Välimäki sur la synthèse soustractive étendue des instruments de musique. Il est revenu à l'Ircam en 2014 pour faire des recherches sur l'indexation et la classification audio avec Geoffroy Peeters. Depuis 2018, il est responsable des recherches sur l'extraction d'informations musicales au sein de l'équipe Analyse/Synthèse.

- Nicolas Obin : Nicolas Obin est chercheur en traitement du signal audio, apprentissage machine et modélisation statistique des signaux sonores avec une spécialisation en traitement de la parole. Son principal domaine de recherche est la modélisation générative de l'expressivité des voix parlées et chantées, avec des applications dans divers domaines tels que la synthèse vocale, les agents conversationnels et la musicologie computationnelle. Il participe activement à la promotion de la science et de la technologie numériques pour les arts, la culture et le patrimoine. Il a notamment collaboré avec des artistes de renom (Georges Aperghis, Philippe Manoury, Roman Polansky, Philippe Parreno, Eric Rohmer, André Dussolier), et a contribué à reconstituer la voix numérique de personnalités, comme le clonage artificiel de la voix d'André Dussolier (2011), le court-métrage Marilyn (P. Parreno, 2012) et le documentaire Juger Pétain (R.Saada, 2014). Il donne régulièrement des conférences pour des écoles réputées (Collège de France, Ecole Normale Supérieure, Sciences Po), des organismes (CNIL, AIPPI) et dans la presse et les médias (Le Monde, Télérama, TF1, France 5, Arte, Pour la Science).

- Grace Leslie : Grace Leslie est flûtiste, musicienne électronique et scientifique. Elle développe des interfaces cerveau-musique et d'autres systèmes de capteurs physiologiques qui révèlent à un public certains aspects de son état cognitif et affectif interne, ceux qui ne sont pas exprimés par le son ou le geste. En tant que compositrice de musique électronique et improvisatrice, elle pratique l'interaction entre le cerveau et le corps. Grace s'efforce d'intégrer les manières d'expression émotionnelle et musicale conventionnelles qu'elle a apprises en tant que flûtiste avec les nouvelles formes qui s'offrent à elle en tant que musicienne électronique, en utilisant l'interface cerveau-corps pour révéler à un public des aspects de son état mental interne, ceux qui ne sont pas exprimés par le son ou le geste. Ces dernières années, elle a joué dans des lieux académiques et populaires, lors de conférences et de résidences aux États-Unis, au Royaume-Uni, en Australie, en Allemagne, à Singapour, en Corée du Sud, en Chine et au Japon, et a publié trois disques de cette musique corps-esprit. Pendant ses études de doctorat (musique et sciences cognitives à l'UCSD), elle a effectué un stage d'un an à l'Ircam à Paris, où elle a collaboré à une installation sonore interactive et réalisé des expériences étudiant l'effet de la participation active sur l'écoute de la musique. Elle a effectué ses travaux de licence et de maîtrise en musique, science et technologie au CCRMA, Université de Stanford.

- Benjamin Levy : Concepteur de musique informatique à l'Ircam, Benjamin Lévy a étudié les deux sciences - principalement l'informatique, avec un doctorat en ingénierie - et la musique. Depuis 2008, il collabore à des projets à la fois scientifiques et musicaux avec plusieurs équipes de l'Ircam, notamment autour du logiciel d'improvisation OMax. En tant qu'ingénieur et développeur en R&D, il a également travaillé dans le secteur privé pour des entreprises spécialisées dans les technologies audio créatives. Il a participé à plusieurs projets artistiques à l'Ircam et ailleurs en tant qu'informaticien pour des œuvres de musique contemporaine ainsi que pour le jazz, l'improvisation libre, le théâtre et la danse. Il a collaboré avec des chorégraphes tels qu'Aurélien Richard, a travaillé sur le théâtre musical avec Benjamin Lazar, et se produit avec le saxophoniste de jazz Raphaël Imbert.

- Philippe Esling : Philippe Esling a obtenu un MSc en acoustique, traitement du signal et informatique en 2009 et un doctorat sur l'appariement des séries temporelles multi-objectifs en 2012. Il a été boursier post-doctoral au département de génétique et d'évolution de l'Université de Genève en 2012. Il est maintenant professeur associé titulaire à l'Ircam, Paris 6, depuis 2013. Au cours de cette courte période, il a rédigé et co-rédigé plus de 15 articles dans des revues prestigieuses telles que ACM Computing Surveys, Publications of the National Academy of Science, IEEE TSALP et Nucleic Acids Research. Il a reçu un prix de jeune chercheur pour son travail dans le domaine de l'interrogation audio en 2011 et un prix de doctorat pour son travail dans l'exploration de données de séries chronologiques à objectifs multiples en 2013. Dans le domaine de la recherche appliquée, il a développé et publié le premier logiciel d'orchestration assistée par ordinateur appelé Orchids, commercialisé à l'automne 2014 et déjà utilisé par une large communauté de compositeurs. Il a dirigé six stagiaires en master, un développeur C++ pendant une année complète, et dirige actuellement deux étudiants en doctorat. Il est le chercheur principal en exploitation de séries chronologiques à l'Ircam, le principal collaborateur du partenariat international France-Canada du CRSH et le superviseur d'un groupe de travail international sur l'orchestration.

Partenaires de l'événement

- Ircam : L'Ircam, Institut de Recherche et Coordination Acoustique/Musique est aujourd’hui l’un des plus grands centres de recherche publique au monde se consacrant à la création musicale et à la recherche scientifique. Lieu unique où convergent la prospective artistique et l’innovation scientifique et technologique, l’institut est dirigé par Frank Madlener, et réunit plus de cent soixante collaborateurs. Il héberge l'Unité mixte de recherche Sciences et technologies de la musique et du son (UMR9912 STMS Ircam - CNRS - Sorbonne Université).

- STMS Lab : Depuis sa création en 1995, le laboratoire STMS a pour mission fondamentale de susciter une interaction féconde entre recherche scientifique, développement technologique et création musicale contemporaine. Cette articulation constitue le principal axe structurant de l’ensemble de ses activités. L’un des enjeux majeurs est de contribuer, par les apports des sciences et techniques, au renouvellement de l’expression musicale. Réciproquement, les problèmes spécifiques posés par la création contemporaine donnent lieu à des avancées scientifiques originales, tant théoriques, méthodologiques, qu’appliquées, dont la portée dépasse largement le seul domaine musical. Les travaux reposent ainsi sur l’articulation de deux types d’activités complémentaires, la recherche et le développement, réalisées dans le cadre de l’unité mixte de recherche Sciences et technologies de la musique et du son (UMR 9912 – STMS) soutenue par le CNRS, Sorbonne Université et le Ministère de la Culture.

- NYU : L'Université de New York est une université de recherche privée basée à New York et fondée en 1831 par Albert Gallatin comme institution pour "admettre sur la base du mérite plutôt que sur la base du droit de naissance ou de la classe sociale". NYU est la plus grande université de recherche indépendante des États-Unis. L'université déploie de nombreux efforts de recherche, notamment en fondant l'American Chemical Society et en établissant des partenariats de recherche avec l'Inception Institute of Artificial Intelligence et avec de grandes entreprises technologiques telles que Twitter et IBM. Depuis, l'université a également lancé divers centres de recherche internes dans les domaines de l'intelligence artificielle, de l'histoire, de la culture, de la médecine, des mathématiques, de la philosophie et de l'économie.

- Georgia Tech : Georgia Institute of Technology, également connu sous le nom de Georgia Tech, est une université publique de premier plan et l'une des principales universités de recherche aux États-Unis. Georgia Tech propose un enseignement axé sur la technologie à plus de 25 000 étudiants de premier et deuxième cycles dans des domaines allant de l'ingénierie, de l'informatique et des sciences aux affaires, au design et aux arts libéraux. La grande variété de majeures et de mineures à orientation technologique de Georgia Tech lui permet d'obtenir de solides classements nationaux. Georgia Tech compte six collèges et 28 écoles axées sur les affaires, l'informatique, le design, l'ingénierie, les arts libéraux et les sciences.

- UC Berkeley : L'Université de Californie est une université de recherche publique. Elle a été fondée en 1868, née d'une vision, inscrite dans la Constitution de l'État, d'une université qui "contribuerait plus encore que l'or de la Californie à la gloire et au bonheur des générations futures". C'est le plus ancien campus du système de l'université de Californie et se classe parmi les meilleures universités du monde dans les principales publications éducatives. Berkeley propose plus de 350 programmes de diplôme par le biais de ses 14 collèges et écoles.